当AI能够像安全研究员一样理解代码逻辑,安全工作不再仅是“发现和解决问题”,而是迈向持续治理与协作重构的新阶段。

一次产品发布,为何引发行业震荡?

2026年2月,Anthropic发布Claude Code Security。这款能够基于语义理解代码结构与逻辑关系的安全智能体,在真实环境中发现了超过500个此前未被识别的高危漏洞。消息公布后,资本市场迅速反应,多家传统安全厂商市值波动明显。市场的剧烈震荡折射出一个深层现实:运用智能体来进行安全运营已成为全球头部AI公司、安全公司共同发展的核心方向。

早在2025年,Google和OpenAI都已经发布了相关自主安全研究智能体工具,并在漏洞识别、漏洞验证、代码审计等诸多场景进行应用,代码安全智能体、漏洞管理智能体以正在经历从 “助手” 到 “协作者” ,从 “规则驱动” 向 “语义推理” 的范式跃迁。这些智能体可以捕捉传统安全工具难以捕捉的业务逻辑缺陷和访问控制失效等复杂漏洞,具备更强大的主动防御能力。

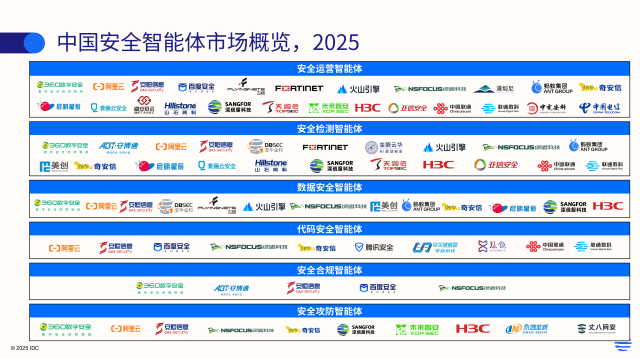

目前,中国已有多家技术服务提供商发布了安全运营智能体、代码安全智能体等相关能力,并开放供最终用户使用。国际数据公司(IDC)于2025年发布了中国安全智能体市场概览,2025:东风已至,未来可期》(Doc# CHC53614225,2025年6月),该报告全面展示了2025年中国安全智能体市场的产品技术发展情况以及市场竞争情况,详情请见下图:

从规则驱动到语义推理:安全能力的底层变化

过去十余年,代码安全体系主要依赖SAST、DAST、SCA等工具。这些工具通过规则匹配、特征识别与漏洞库对比完成扫描任务,在已知漏洞检测、依赖组件风险识别以及合规支持方面发挥了重要作用。然而,伴随应用架构的微服务化、业务逻辑的复杂化,以及AI生成代码的比例不断上升,传统基于规则的检测方式在某些场景中已经难以适配用户的安全检测需求,如其难以识别跨模块逻辑漏洞、难以理解权限链条与业务流程、难以处理语义层面的访问控制问题以及自动修复能力有限等。

代码安全智能体的出现,正是对这些短板的回应。基于大模型的语义理解能力,智能体可以跨文件分析上下文关系,模拟安全研究员的推理过程,识别复杂逻辑缺陷,并给出针对性修复建议。这种变化的意义在于,安全能力开始具备“理解”而非仅“匹配”的特征。安全流程也因此不再局限于漏洞扫描,而是向自动修复与流程嵌入延伸。

替代还是协作?行业结构正在重组

伴随技术突破而来的,是关于“替代”的讨论。安全智能体是否会取代传统工具?是否会削弱安全团队的价值?

从当前技术实践看,更合理的判断是能力重组,而非全面替代。

传统SAST、DAST、SCA工具在稳定性、规模化扫描、合规审计以及零日漏洞识别方面仍然不可或缺。尤其是在遗留系统和第三方组件治理场景中,规则工具具有成熟优势。

而智能体更擅长语义推理、复杂场景识别与自动化修复。它弥补了传统工具在上下文理解与闭环能力上的不足,却并未消除对人工判断与策略设计的需求。事实上,当前主流安全智能体产品均保留人工审批机制。这一设计本身表明,在风险决策、异常处理以及责任承担方面,人类依然是关键节点。未来,传统工具会快速嵌入智能体能力实现AI原生安全检测、自动化修复等问题,其安全流程从“检测-修复-审计”转向“预防-检测-修复-治理-审计”的全链路闭环。

企业安全运营模式正在发生转型

技术能力的变化,正在反向推动安全运营模式重构。

首先,安全工作加速左移。智能体能够嵌入CI/CD流程,在代码提交阶段进行实时分析与反馈,使安全从事后扫描转向前置控制。

第二,安全效率显著提升。代码审查、漏洞验证、修复建议生成等高重复性工作可实现自动化,安全团队得以将更多精力投入策略设计与复杂风险分析。

第三,安全能力逐步形成闭环。检测不再是终点,而是治理流程的一部分。风险识别、优先级排序、修复执行与复盘优化可以形成持续循环体系。

这一转型意味着,企业不应仅关注“是否使用智能体”,而应重新思考整体安全架构如何适应这一趋势。

企业应如何布局安全智能体?

面对这一变化,企业需要保持理性与节奏感,而非盲目替换现有体系。

首先,应从架构层面评估智能体的嵌入方式。将其作为增强模块接入现有安全能力体系,通过接口与流水线集成,实现能力协同,而非简单的工具叠加。

其次,可以从高频、低风险场景切入。例如代码审查自动化、依赖漏洞筛查、修复建议生成、安全报告生成等场景,既能体现效率优势,又能控制风险边界。在积累实践经验后,再逐步扩大应用范围。

再次,企业需要同步建立治理机制。明确智能体的决策边界、人工审批节点与异常回滚机制,确保自动化能力在可控范围内运行。

同时,未来企业的安全团队也将以“人+智能体”协同为主流运营模式。安全团队也应做好角色升级准备。未来的安全工程师将更多参与风险评估、模型调优与安全策略设计等复杂任务的处理上。

安全智能体不是终点,而是协作时代的起点。

IDC更多相关研究

IDC已于2026年启动AI安全技术系列研究,围绕AI原生安全架构、安全智能体成熟度评估、AI驱动DevSecOps实践路径及企业级AI治理框架展开深入分析。

如需进一步了解与研究相关内容或咨询 IDC其他相关研究,请点击此处与我们联系。